VR 헤드셋을 쓰고, 왜 키보드를 찾게 되는가

.

Written by zeepada | Edited by @syntaxional

여러분은 VR 헤드셋을 쓰고, 메시지를 작성해본 적 있으신가요?

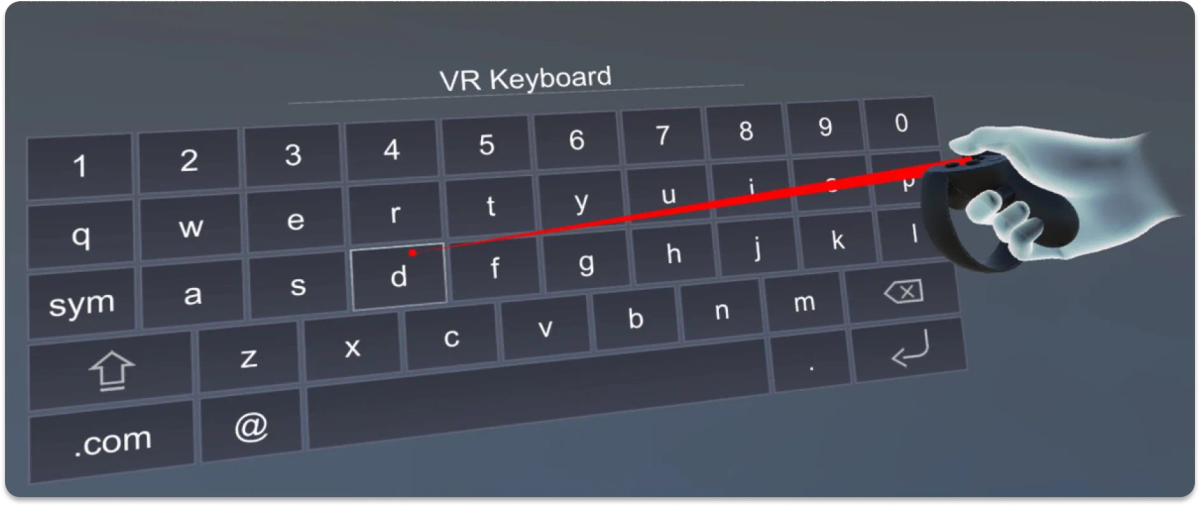

허공에 떠 있는 가상 키보드를 핸드 핀치로 한 글자씩 찍어가며 "회의 시간 변경 요청드립니다"를 입력합니다.

ㅎ ㅗ ㅣ ㅇ ㅡ ㅣ [ ] ㅅ ㅣ ㄱ …

오타를 수정하려다 커서가 엉뚱한 곳으로 날아갑니다. 지우고 다시 누르다가 다른 버튼을 눌렀습니다. 키보드가 닫혔네요. 결국 헤드셋을 벗고 스마트폰을 집어 들거나, Bluetooth 키보드를 연결합니다.

이게 정말… "미래"일까요?

이 글에서는, XR의 다양한 입력 관련 UX 문제 중에서도, 텍스트 입력에 집중하고자 합니다.

왜 하필 텍스트일까요? 우리는 하루에도 수천 단어를 씁니다. 이메일, 메시지, 검색, 코드, 메모. 텍스트는 인간이 가진 가장 정밀하고 보편적인 의사소통 수단입니다. 청각을 사용하는 음성 대화와 영상 매체는, 놀랍게도 시각을 사용하는 텍스트의 정교함과 효율성에 못 미칩니다.

결국 XR이 진정한 생산성 도구로 자리 잡으려면, 텍스트를 빠르고 정확하게 입력하고 편집하는 문제를 반드시 해결해야 합니다. 그렇기에 오히려, 지금 텍스트 입력은 XR의 가장 취약한 고리입니다.

1. 가상 모니터의 역설

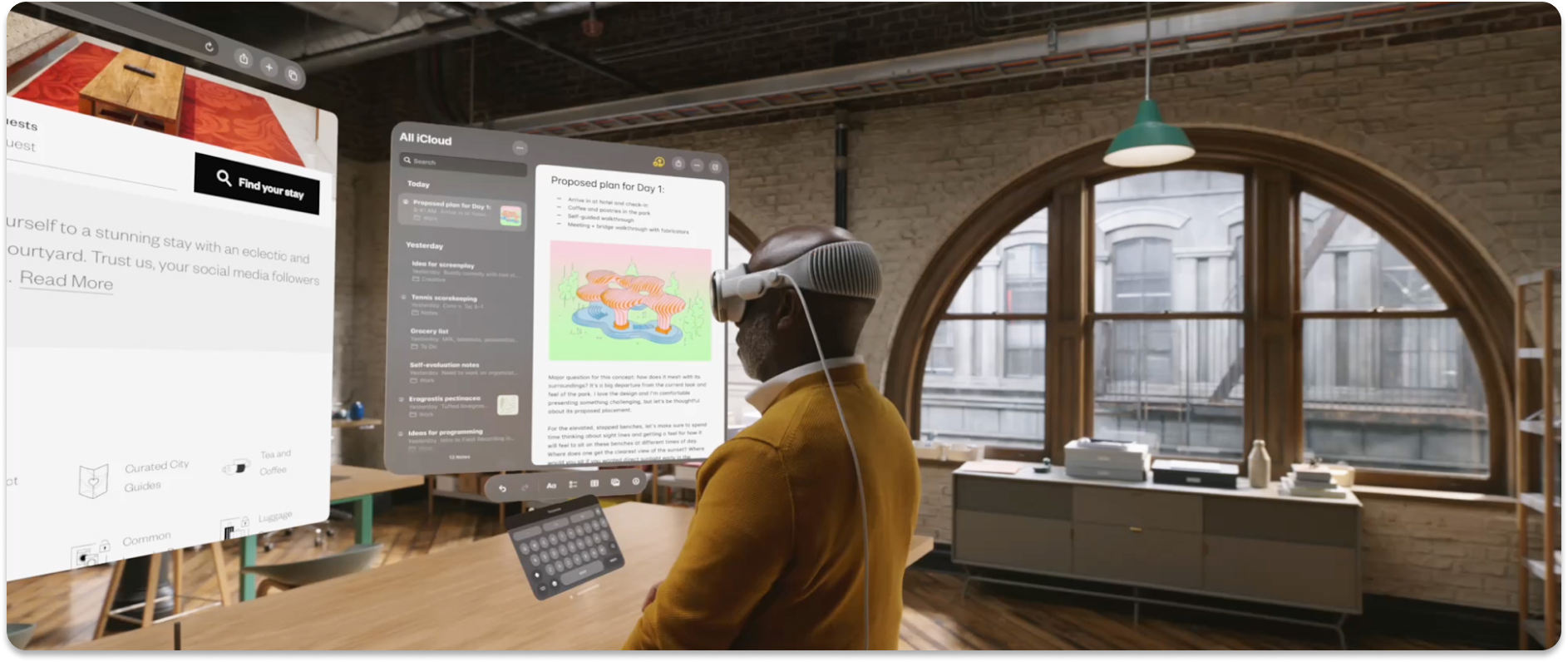

Apple은 Vision Pro를 ‘공간 컴퓨터’라 부르고, Meta는 Quest를 ‘가상 오피스’로 마케팅합니다. 실제로 거대한 가상 모니터 여러 개를 허공에 띄우고 몰입감 있는 환경에서 작업할 수 있습니다. 그러나 근본적인 모순이 있습니다.

물론 Quest 덕분에 Output은 확실히 확장됐습니다. 27인치 모니터 대신 방 전체를 캔버스로 쓸 수 있죠. 그러나 Input은요? 여전히 물리적 키보드와 마우스를 연결해야 합니다. 혁신적인 공간 컴퓨팅 기기의 실제 사용 모습은 이렇습니다: XR 헤드셋을 쓰고, 책상에 앉아 키보드와 마우스를 연결하고, 기존 데스크탑의 앱을 띄워서 작업합니다.

결국 XR 헤드셋은 그냥 “머리에 쓰는 대형 모니터”라고 평가하는 이들이 많은 까닭입니다.

차원은 늘었는데, 입력은 2D에 머문다

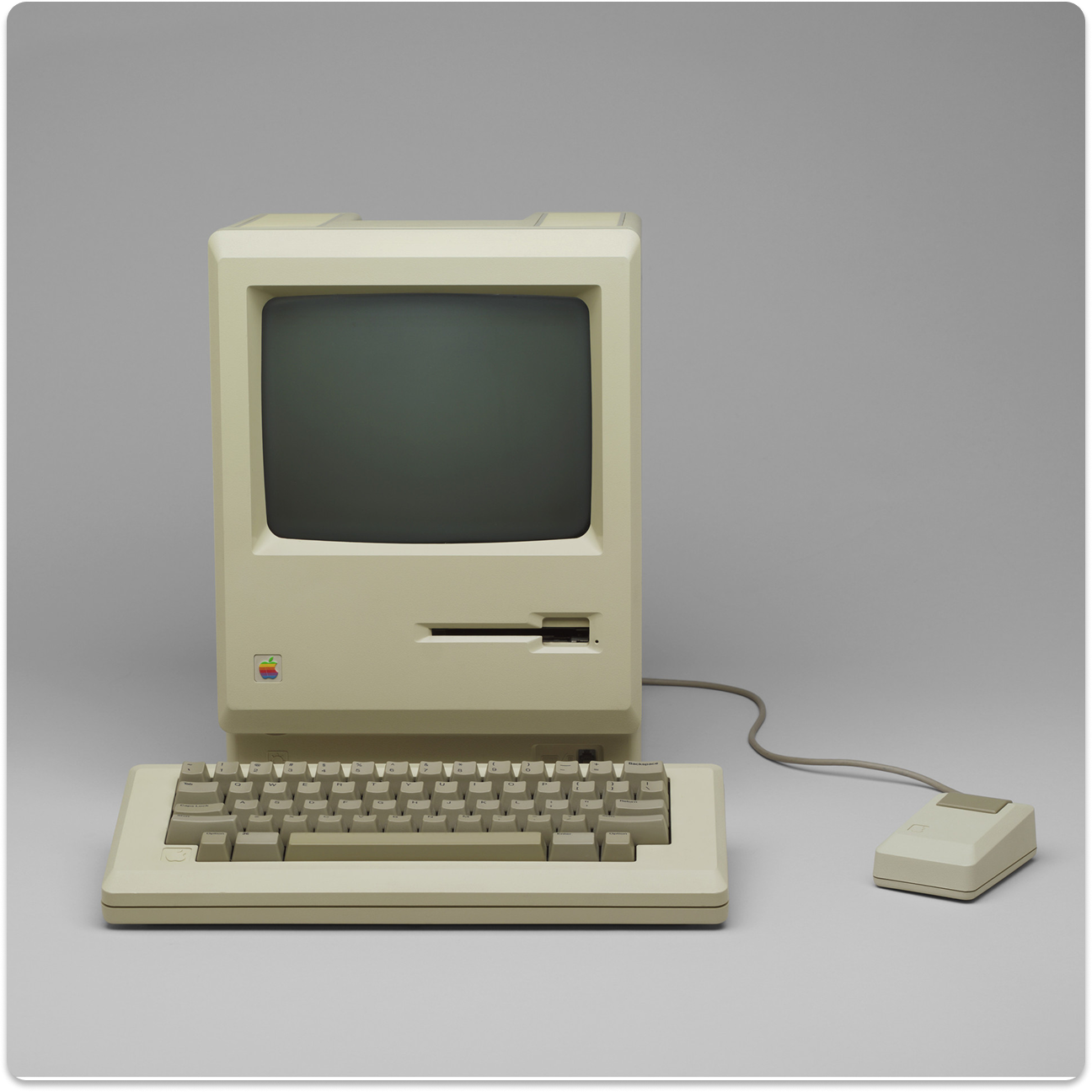

디지털 UX 발전 역사를 살펴봅시다. 당연하게도, 키보드와 마우스는 2D 스크린을 위해 설계됐습니다. X-Y 좌표 위에서 포인터를 움직이고 순차적으로 문자를 입력하는 방식은 1984년 매킨토시 이후 40여 년간 거의 변하지 않았습니다. 그리고 이 패러다임이 3D 공간에 이식된 것이, 지금의 모든 XR UX입니다.

- VR 컨트롤러: 본질적으로 6DoF 포인터입니다. 레이저 빔으로 가리키고 트리거를 당기는 방식으로 결국 공간 속의 마우스 입니다.

- 핸드 트래킹: 손가락 끝으로 가상 버튼을 누르는 행위는 터치스크린의 3D 버전입니다. 80년대부터 이미 경고된 고릴라 암Gorilla Arm 증후군이 여기서도 발생합니다.

- 가상 키보드: QWERTY 배열을 허공에 띄워놓고 한 손가락씩 찍는 것은, TV 리모콘으로 YouTube 검색어를 입력하는 고통을 그대로 재현합니다.

물론 이것이 현재 최선일 수 있습니다. 그러나 2D에서 3D로의 전환은 단순히 축을 하나 더하는 것이 아닙니다. 이미 많은 연구자들이 그 점을 인지한 뒤 파고들고 있죠. 즉, 우리는 인간이 공간과 상호작용하는 방식 자체를 재발명해야 합니다.

숫자로 보는 Input의 현실

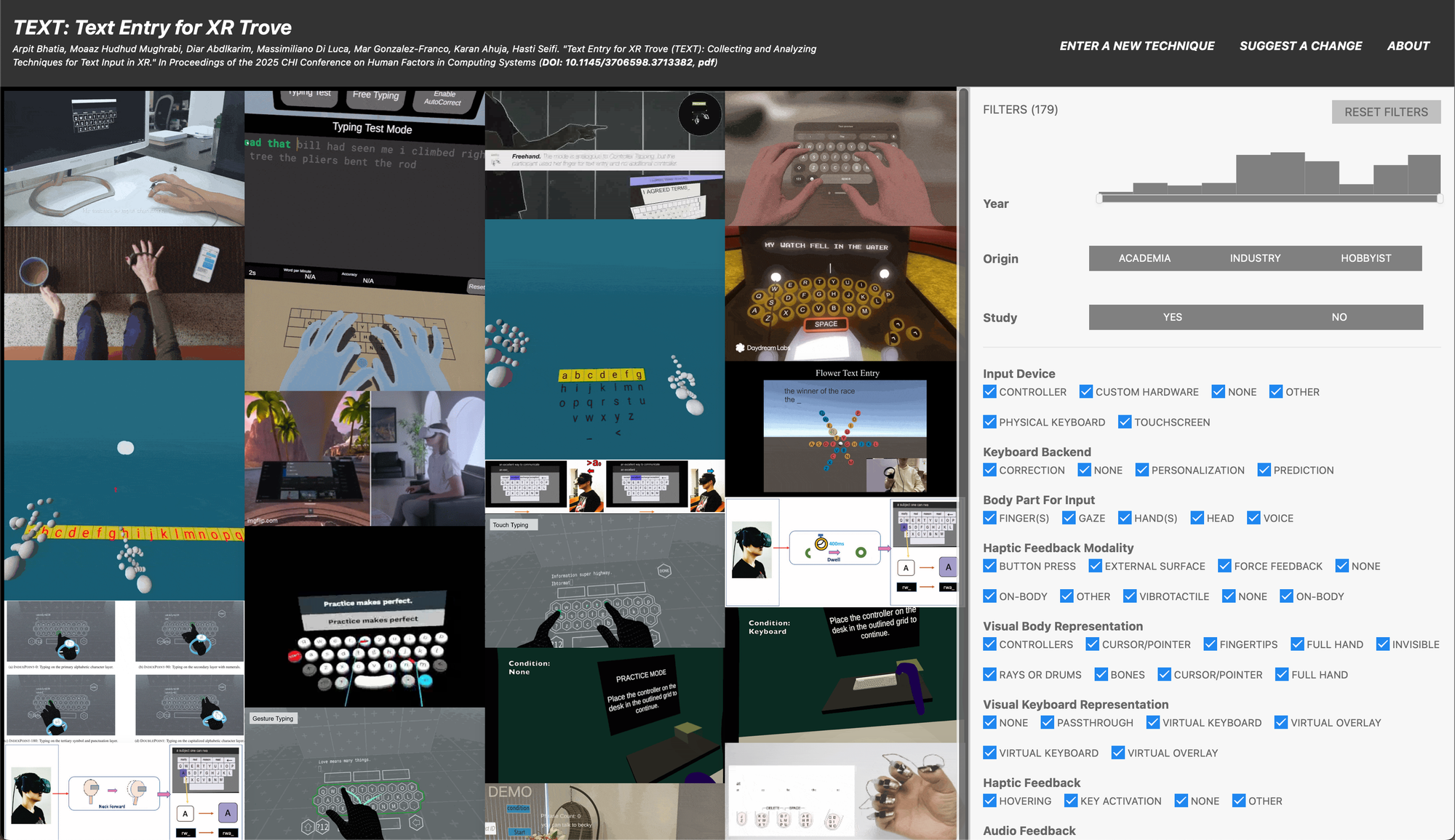

2025년 CHI에서 발표된 XR TEXT Trove 연구(Bhatia et al., 2025)—버밍엄 대학, 코펜하겐 대학, Max Planck 연구소, Northwestern 대학, Google 등 공동 수행—는 176가지 XR 텍스트 입력 기술을 체계적으로 분석한 가장 큰 규모의 메타 연구입니다.

흥미로운 점은 XR 환경의 텍스트 입력 속도가 전반적으로 평균 20 WPM 정도에 머문다는 사실입니다. VR이나 MR을 막론하고, 가상 키보드·컨트롤러·핸드트래킹 기반 입력 모두 비슷한 범위 내에 있고, 가장 빠른 방식조차 전통적인 데스크톱 물리 키보드 (평균 40–60 WPM, 숙련자는 80 WPM 이상)에 비해 절반 이하 수준에 그칩니다.

즉, 아직까지도 XR 환경에서 전통적 물리 키보드를 능가하는 입력 방식은 없다고 볼 수 있습니다. 따라서 XR 기기들이 진정한 생산성 디바이스로 도약하기 위해서는, 복합적으로 작동하는 입력 기술 전체 스택의 재설계가 필요하다는 점이 더욱 분명해집니다.

2. 전통적인 시도들: 왜 충분하지 않은가

Hand Tracking의 근본적 한계

손으로 가상의 키보드를 치는 것은, 단순히 생각해보면 문제가 없어보입니다. 현실에서도 물리적인 키보드를 맨손으로 타건하기 때문이죠. 하지만 XR에서의 키보드는 물리적이지 않아서 문제입니다.

먼저, Midas Touch 문제라는 것이 있습니다. 의도와 상관 없이 손에 닿는 모든 것을 금으로 만드는 미다스 왕처럼, 사용자의 의도와 달리 오입력 또는 과입력이 발생하는 것을 의미하죠. 핸드 트래킹에서, 사람의 눈과 손이 끊임없이 움직이기 때문에 오입력이 늘어나는 것 또한 그 사례입니다. 즉, "보는 것"과 "선택하는 것"을 구분하기 위해 항상 별도의 확인 동작이 필요합니다.

그럼에도 불구하고 여전히 핸드 트래킹은 클릭이 없습니다. 물리적 버튼은 촉각 피드백으로 입력 완료를 확신시켜 줍니다. 하지만 허공에서의 핀치는 "입력이 됐나?"라는 불확실성을 동반합니다. 이에 이어지는 신체적 및 정신적 피로도는 덤이죠. 특히 허공 타이핑은 물리적 표면에서보다 근육 피로도가 높다는 연구 결과가 다수 등장했습니다..

Voice Input: 만능 해결책이 아닌 이유

이에, 최근 XR 하드웨어 기업들은 음성 입력을 주된 해결책으로 선택하고 있습니다. 음성 대화는 원시 시대부터 인류가 유지해 온 소통 방식이기도 하며, 특히 우리는 AI와의 UX도 음성 대화에 익숙해지고 있죠. 하지만 그만큼, 음성 입력은 다른 의미로 물리적인 한계가 명확합니다.

우선 사회적 맥락을 생각해봅시다. 비교적 조용한 사무실에서, 혹은 대형 카페에서 헤드셋을 쓰고 혼잣말하는 것은 어색합니다. 외부의 시선을 신경 안 쓸 수도 있겠지만요. 그리고 프라이버시 문제는 어떻게 되나요? 비밀번호나, 민감한 메시지를 소리 내어 말할 수 있을까요? 물론 그렇기에 지문 인식 등의 대안을 생각할 수는 있을 것입니다. 하지만 문제는 그 뿐만이 아닙니다.

음성 입력은 편집이 어렵습니다. "세 번째 문장의 두 번째 단어를 삭제하고... 다섯 번째 문장의 네 번째 단어를…" 이렇게 지시하는 것은 직접 커서를 움직이는 것보다 인지 부하가 큽니다. 마지막으로 인간에게는 조용한 생각이 필요하기도 합니다. 특히 글쓰기는 생각을 정제하는 과정입니다. 하지만 음성은 내면의 사고를 즉시 외부로 발화하도록 강제하죠. 문어체로 발화할 수는 있겠지만… ‘그것은 어려운 일이노라.’

3. 새로운 가능성: Input 패러다임의 재발명

전통적인 두 가지 방식들을 뒤로 하고, 2025년 현재, 이제는 몇 가지 유망한 방향이 실제 제품으로 등장하기 시작했습니다.

Meta Neural Band: 근육이 말을 걸다

2025년 9월 Meta Connect에서 발표된 Meta Neural Band는 표면 근전도(sEMG) 기술을 사용해 손가락이 움직이기 전에 근육의 전기 신호를 감지합니다. Zuckerberg는 이를 "컴퓨팅 역사의 새로운 장"이라 표현했습니다. 이어서 Meta의 Thomas Reardon은 중요한 점을 강조합니다: "이것은 '마인드 컨트롤'이 아닙니다. 생각이 아니라, 운동 정보를 제어하는 뇌 부분에서 오는 신호입니다."

주요 특징은 다음과 같습니다.

- 캘리브레이션 불필요: 수천 명의 데이터로 훈련된 ML 모델이 개인 맞춤 설정 없이도 작동

- 미세 제스처 감지: 엄지와 검지를 살짝 비비는 정도의 동작으로 스와이프, 탭, 핀치 명령 가능

- 손글씨 입력: 책상, 테이블, 허벅지 위에서 손가락으로 글씨를 쓰면 인식

TapXR: 코드의 귀환

이번에는 근전도와 전혀 다른 접근법입니다. TapXR은 손목 밴드로, 손가락이 어떤 표면이든 두드리는 패턴을 감지해 키보드 입력으로 변환합니다. QWERTY 배열 대신 손가락 조합(코드)으로 문자를 입력합니다. 마치 피아노 코드처럼. 학습에 시간이 필요하지만, 제조사에 따르면 숙련 후에는 한 손으로 70 WPM 이상 달성이 가능하다고 합니다.

주요 특징은 다음과 같습니다.

- 물리적 표면 활용: 책상, 소파 팔걸이, 허벅지 등 아무 데나 두드리면 됩니다. 고릴라 암 문제 해소

- 시선 분리: 키보드를 볼 필요 없는 진정한 "눈 자유(eyes-free)" 입력

- 99% 이상 정확도: 위치가 아닌 동작 패턴 기반

흥미롭게도 이 방식은 1968년에 먼저 등장했다고 합니다. 무려 UX 계의 조상이라고 할 수 있는, Douglas Engelbart의 '모든 데모의 어머니Mother of All Demos'에서 이미 제안된 아이디어인데요, 당시 Engelbart는 5개 키의 조합으로 전체 알파벳을 입력하는 '코드 키셋(chord keyset)'을 시연하며, 이를 '한 손으로 키보드가 할 수 있는 모든 것의 equivalent'라고 설명했습니다.

모든 데모의 어머니의 수많은 UX들이 현실에서 활용되고 있으니, 코드 키셋 역시 부활을 노리는 것일까요?

컨텍스트 인식 AI: 입력량 자체를 줄이다

어쩌면 진짜 해결책은 "더 빠른 타이핑"이 아니라 "타이핑 자체를 줄이는 것"일 수 있습니다.

Spatial AI Agent는 사용자의 맥락(현재 보고 있는 객체, 이전 대화, 위치, 시간)을 이해하고, 최소한의 입력으로 복잡한 명령을 추론합니다. "저기 있는 그거"라고 말하면서 시선이 향하는 곳의 객체를 AI가 특정합니다. 완전한 문장 대신, 단서(cue)와 의도(intent)의 조합으로 소통하는 것입니다.

스마트폰의 스와이프 타이핑이 터치 입력을 혁신했듯, AI 기반 예측과 자동완성이 XR 입력의 게임 체인저가 될 수도 있습니다.

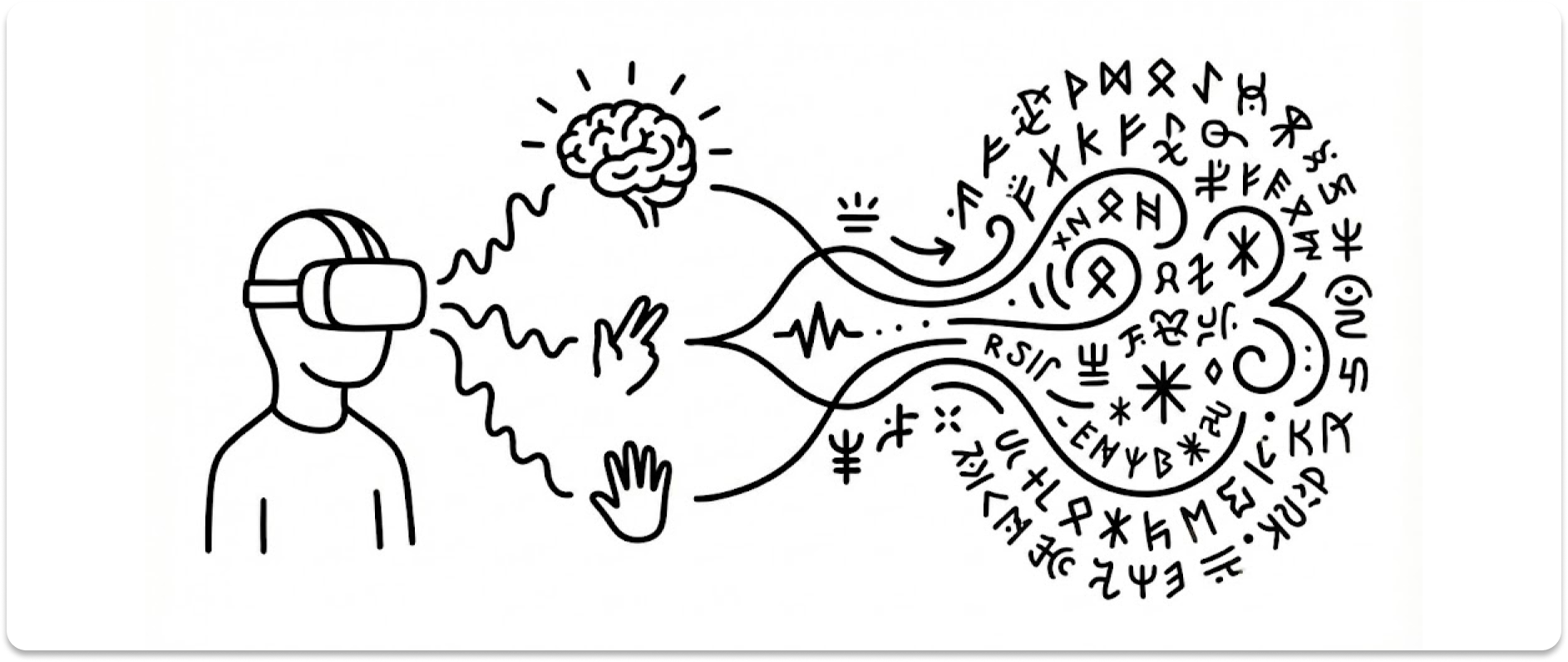

Brain-Computer Interface: 궁극의 Input?

EMG가 근육 신호를 읽는다면, BCI는 뇌 신호 자체를 읽습니다. BCI는 모든 입력 방법보다 한 차원 높은, 그야말로 XR Input의 성배로 불리지만, 현실과 기대 사이에는 간극이 있습니다.

- OpenBCI의 방법론

비침습적 BCI 기기들은 크게 두 가지 방향으로 발전하고 있습니다. OpenBCI의 Galea는 EEG, EMG, EDA, PPG 등 다중 센서를 VR 헤드셋(Varjo Aero)에 통합한 연구용 플랫폼으로, 특히 EMG 센서를 활용해 얼굴 근육의 미세한 움직임을 직접적인 커맨드로 변환할 수 있습니다. 실제로 뺨 근육을 살짝 움직여 게임 캐릭터를 조종하는 데모가 공개된 바 있습니다. 반면 Neurable의 MW75 Neuro 헤드폰(2024)은 이어컵에 내장된 12채널 EEG로 집중도와 인지 상태를 측정하는 패시브 모니터링에 집중합니다.

물론 순수한 EEG 기반 비침습적 BCI로 신뢰성 있게 구현 가능한 것은 여전히 1-bit 수준의 단순한 확인 신호 정도입니다. 하지만 이 1-bit만으로도 시선 추적과 결합하면 Midas Touch 문제를 해결할 수 있습니다. "보는 것"과 "선택하는 것"의 분리가 가능해지기 때문입니다.

- Apple의 BCI 공식 지원

2025년 5월, Apple은 BCI HID 프로토콜을 발표해 뇌 신호를 터치, 음성과 동등한 공식 입력 방식으로 인정했습니다. Synchron의 Stentrode 임플란트가 첫 공식 파트너 기기입니다. Stentrode는 개두술 없이 경정맥을 통해 뇌의 운동 피질 혈관 표면에 삽입되는 방식입니다.

사실 공식 발표 이전에 이미 성과가 있었습니다. 2024년 8월, ALS 환자 Mark Jackson은 Stentrode를 통해 생각만으로 Vision Pro를 제어하는 데 성공했습니다. 솔리테어 게임을 하고, 메시지를 보내는 것이 가능했습니다. 2025년 5월 발표의 의미는 이러한 기술을 OS 레벨의 공식 표준으로 격상시켰다는 점입니다. 뇌 신호가 마우스나 키보드처럼 네이티브 입력으로 인정받게 된 것입니다.

다만 침습적 BCI는 당분간 의료 목적에 국한됩니다. 일반 소비자에게는 Meta의 sEMG처럼 뇌가 아닌 근육에서 신호를 읽는 접근이 더 현실적입니다. 그럼에도 BCI 연구가 중요한 이유는 Input의 본질적 질문을 던지기 때문입니다. 물리적 동작 없이 의도를 직접 전달하는 것이 XR Input의 궁극적 방향일 수 있습니다.

4. XR Input의 미래: 두 가지 경로

다시 현재로 돌아와서, 결국 모든 방법론들이 현재는 물리 키보드를 넘지 못한다는 것이 안타까운 사실입니다. 그러나 이 우리는 사실을 두 가지 방향으로 해석할 수 있습니다. 텍스트 입력 방식 자체를 재발명하거나, 텍스트 입력의 필요성 자체를 줄이거나.

경로 1: 입력 방식의 재발명

역설적으로, 지금의 혼란은 기회입니다. XR Input에는 아직 지배적 표준이 없습니다. TapXR의 코드 입력, EMG 기반 손글씨 인식 같은 시도들은 이제야 "키보드 없는 문자 입력"을 모색하는 걸음마 단계입니다. 그리고 이것은 아이러니하게도, 현실에서 수십년 공식이 된 키보드가 가상 공간에서 어울리지 않기 때문이죠.

새로운 환경에서, 초기 단계의 UX 연구가 중요한 이유입니다. 3D 공간에서 어떤 제스처가 자연스럽고, 어디서 인지 부하가 발생하는지. 지금 성급하게 채택된 방식은 XR의 "QWERTY"가 되어 수십 년간 우리를 속박할 수 있습니다. 그것이 우수하다면 좋지만, 그렇지 않다면?

경로 2: 입력 필요성의 축소

AI 자동완성, 컨텍스트 인식, 음성-텍스트 변환의 조합은 타이핑 없는 텍스트 생성을 향해 가고 있습니다. 사용자가 의도를 표현하면, AI가 완전한 문장을 구성합니다. 물론 AI 차원의 Midas Touch 문제가 있기도 합니다. AI는 보통 사용자가 의도하지 않은 내용들을 마음대로 추가하기도 하죠. 그리고 그것을 수십 분 동안 고집하기도 합니다.

어찌되었든, 이 경우가 주를 차지했을 때 인간의 역할은 곧 창작자가 아니라 편집자로 옮겨질 것입니다. 인간이 의도를 입력하면, AI가 그것을 적절한 Input 데이터로 변환합니다. 이후 인간이 편집을 진행하죠.

그러나 이러면 또 다른 문제가 발생합니다. 커서 이동, 단어 선택, 수정 인터랙션이 새로운 디자인 과제가 됩니다. 정밀한 편집을 위한 인터페이스는 대량의 텍스트 입력과는 전혀 다른 설계를, 즉 지금까지 분량의 칼럼 몇 편을 더 요구합니다.

공통 원칙: 적응하는 시스템

모든 것이 정답일 수도 있고, 하나를 제외한 모든 것이 본인에게는 어색할 수 있다.

두 경로 모두에서 한 가지는 분명합니다. 처음부터 완벽한 범용 인식률을 목표로 하는 것은 비현실적입니다.

Meta의 sEMG 연구팀은 흥미로운 사실을 발견했습니다. 소량의 개인 데이터만 축적돼도 손글씨 인식 정확도가 16% 향상된다는 것입니다. 모든 사용자에게 통하는 완벽한 솔루션을 고집하기보다, 각 사용자에게 점진적으로 적응하는 시스템이 더 현실적입니다.

이 관점에서 오류는 실패가 아니라 학습의 기회입니다. 사용자가 오타를 수정할 때마다 시스템은 그 사람의 입력 패턴을 더 정확히 이해하게 됩니다. 중요한 것은 이 수정 과정이 자연스러워야 한다는 것입니다. 오류 수정이 매끄러울수록 사용자는 더 많이 수정하고, 시스템은 더 빠르게 적응합니다.

나가며

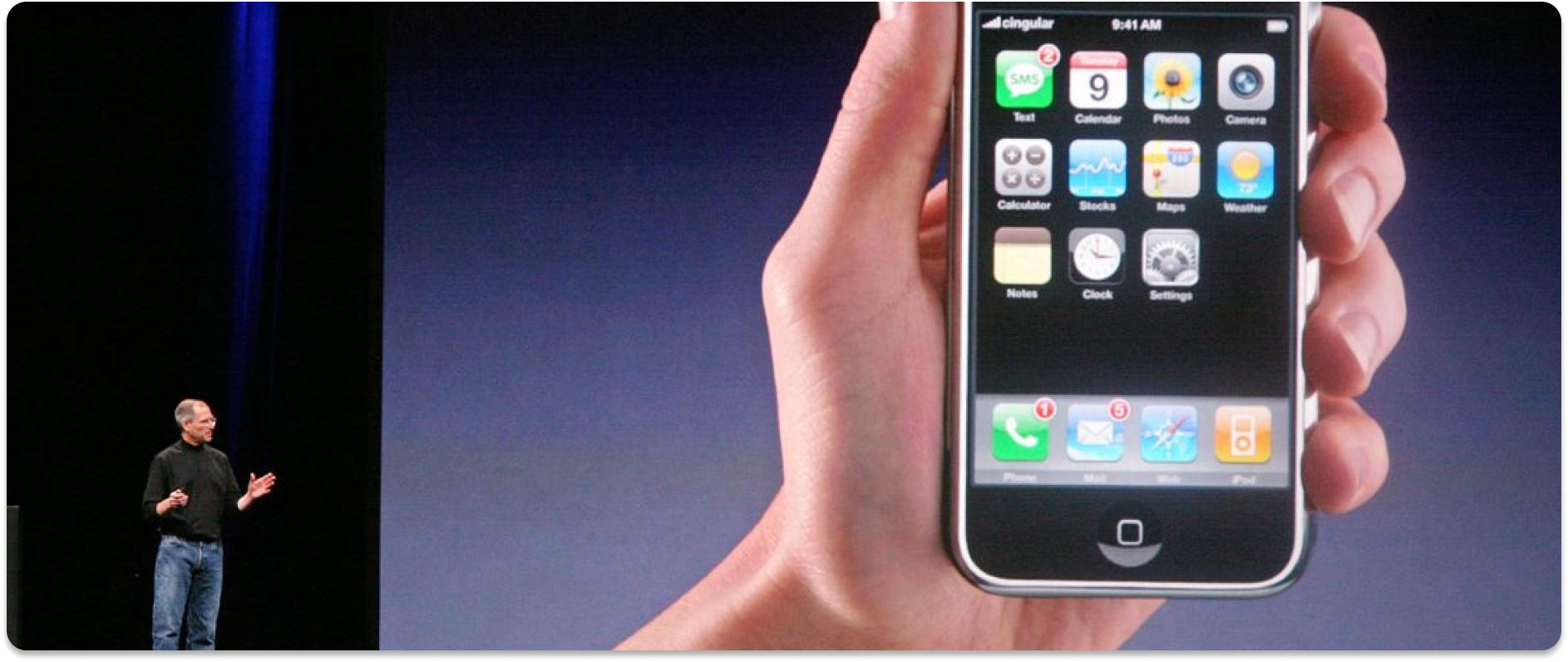

누군가는 이렇게 말합니다. “적응하면 괜찮아져요.” 그러나 진정한 기술 혁신은 사용자에게 적응을 요구하지 않습니다. 마우스가, 터치스크린이, 스마트폰 키보드가 성공한 이유는 인간의 기존 행동 양식에 자연스럽게 녹아들었기 때문입니다.

Output만 3D로 확장하고 Input은 2D에 머무는 것은 절반의 혁명입니다. 터치스크린 스마트폰에 물리 키보드를 필수로 연결해야 했다면 아이폰이 세상을 바꿨을까요?

이 글 전체를 관통하는 질문은 결국 텍스트에 관한 것이었습니다. 허공의 키보드로 20 WPM을 간신히 달성하는 것, 헤드셋을 벗고 스마트폰을 집어 드는 것, Bluetooth 키보드를 연결하는 것. 이 모든 해결책은 사실 XR이 텍스트 입력 문제를 해결하지 못했음을 방증합니다.

그러나 어쩌면 답은 “더 나은 가상 키보드”가 아닐 수 있습니다. EMG가 손가락 움직임을 키 입력으로 바꾸고, AI가 몇 단어의 힌트에서 완전한 문장을 생성하고, BCI가 의도를 직접 읽는 미래에서, 타이핑이라는 개념 자체가 재정의될 것입니다. 텍스트는 사라지지 않겠지만, 텍스트를 만드는 방식은 완전히 달라질 수 있습니다.

XR의 Output은 이미 충분히 인상적인 수준에 도달했습니다. 현재 XR 인터페이스에서 병목은 Input에 있습니다. Output이 아무리 확장되어도, Input이 해결되지 않으면 XR은 영원히 얼굴에 쓰는 대형 모니터에 머물 것입니다. 그리고 Input 문제의 핵심에는, 아직도 우리가 150년 전의 타자기 방식으로 생각을 문자로 바꾸려 한다는 사실이 있습니다.

여러분들에게 질문하고 싶습니다. 3D 공간에서 인간은 어떻게 '쓰고' 싶어 할까요?

참고자료

- Bhatia, A. et al. (2025), "Text Entry for XR Trove (TEXT): Collecting and Analyzing Techniques for Text Input in XR," CHI 2025 https://xrtexttrove.github.io

- Engelbart, D. C. & English, W. K. (1968), "A Research Center for Augmenting Human Intellect," AFIPS Fall Joint Computer Conference

- Kaifosh, P., Reardon, T. R. et al. (2025), "A generic non-invasive neuromotor interface for human-computer interaction," Nature

- Kekatos, M. (2024, August 2), "How Apple's Vision Pro is helping this ALS patient to perform simple tasks," ABC News. https://abcnews.go.com/Health/apples-vision-pro-helping-als-patient-perform-simple/story?id=112433752

- Master & Dynamic & Neurable (2024), "MW75 Neuro," CES 2024 Innovation Award Honoree. https://www.ces.tech/ces-innovation-awards/2024/mw75-neuro/

- Meta (2025, September 17), "Meta Ray-Ban Display: AI Glasses With an EMG Wristband," Meta Newsroom. https://about.fb.com/news/2025/09/meta-ray-ban-display-ai-glasses-emg-wristband

- OpenBCI (2023), "Combining VR and Neurotechnology with OpenBCI's Galea," Varjo. https://varjo.com/vr-lab/combining-vr-and-neurotechnology-with-openbcis-galea

- Synchron (2025, May 13), "Synchron To Achieve First Native Brain-Computer Interface Integration with iPhone, iPad and Apple Vision Pro," Business Wire. https://www.businesswire.com/news/home/20250513927084/en

- Tap Systems Inc., "TapXR," Product Page. https://www.tapwithus.com